*本文首发于 Cocos 官方公众号。

提问时间:你想创造一个专属自己的虚拟人形象吗?

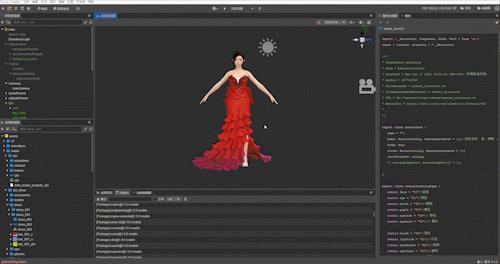

比如,这样的⬇️

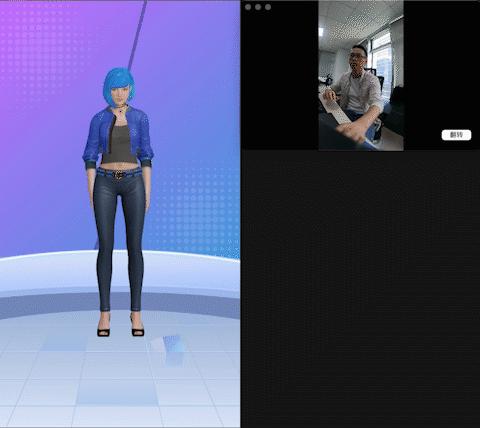

或者是,这样的⬇️

从初音未来到爆红抖音的柳夜熙,再到上个月,全球最大奢侈品集团 LVMH 官宣即将推出虚拟形象大使,作为时尚弄潮儿的 C 姐怎么能不拥有属于自己的虚拟人形象(我不管,别的小朋友有的,我也要),因此在 v3.5 更新的百忙之中,可爱的同事们在 C 姐的“好言相劝”下,基于 Cocos Creator v3.5 开始了在虚拟人领域的探索。

更自由、更轻量,纵享丝滑捏人体验

现如今虚拟人的“玩法”越来越多。他们可以是虚拟偶像、娱乐明星、带货主播、手语翻译、品牌形象大使、企业员工……活跃在各个行业和领域的虚拟人,正在无限拓展我们的想象。

元宇宙的火热无疑为虚拟人带来了更多关注。虽然目前元宇宙还只是一个模糊的概念,但可以预见,虚拟人将是未来元宇宙世界的核心要素之一,而制约其发展核心之一在于技术能力,对建模、驱动、渲染、人工智能等技术水平要求都比更高。

作为一款成熟的商业 3D 引擎,Cocos 沉淀了深厚的引擎底层技术能力和与丰富的开发实践经验,这些都能为开发者大大地压缩了打通虚拟人关键技术的时间成本,简单来说——目前 Cocos 基于虚拟人已实现的建模、口型、动捕、渲染、AI 接入五大关键技术,未来都会对外开放,让大家纵享丝滑捏人体验。

这仅仅是 Cocos 现阶段在虚拟人领域所做的探索与实验,随着引擎 3D 渲染技术的进展(温馨提醒~大家可以戳戳最新图形渲染 DEMO),同时由于 Cocos 轻量、高效能的特点,开发者不仅可以创造足够逼真的 3D 形象,而且能在最小的算力范围内,达到最优的虚拟人效果,实现覆盖大多数低算力设备及操作系统。

建模、驱动、渲染,在编辑器内实时运行

刚刚说到,Cocos 已经实现了创造虚拟人所需的关键技术,而且这些 3D 形象支持完整的人体骨骼和面部绑定,并且可以实时运行在 Cocos 引擎中。

当前虚拟角色已经能够在手机端进行高级别卡通写实人物的实时渲染,在骁龙865机型上保持30万面左右 60FPS 的同时,进行面捕捕捉和捏脸换装。

Point 1:高度自定义角色编辑

预置角色模型拥有多达263个脸部、身体调节系数,支持用户自主开发独一无二的虚拟形象。同时 AI 建模技术能让用户利用照片快捷生成真人数字化身。

Point 2:人物动态捕捉及采集技术

骨骼动画重定向后能让虚拟人拥有无限的动作表现潜能。一张照片、一段视频,无需专业动捕演员,你的虚拟形象便能拥有精彩的动作表现。

Cocos 已经实现了通用摄像头进行较低精度动作捕捉。目前正在尝试通过 RGB-D 的摄像头解决动作捕捉遮挡定位与 3D 空间关系问题。同时基于 AI 训练,自动补全视觉当中图像未可见部分的手部、脚部等 3D 空间位置,自动预判躯干前后遮挡关系。

Point 3:面部系统捕捉技术

Cocos 实现基于视频的高精度实时表情捕捉技术,利用大量视频数据来训练模型,最终产生高质量的连续变形体(Blendshape)权值输出,用于驱动完整的虚拟角色,实时表情捕捉效果与离线效果相近,可实现高精度捕捉。

Point 4:口型驱动技术

语音口型驱动是通过对音频中的音素进行识别,同样通过大量的数据 AI 训练模型,以 mesh 变换的形式驱动 3D 人物口型,从而达到高拟真语音播报。

Point 5:AI 骨骼绑定技术

完善的骨骼标准及骨骼重定向是驱动人物的关键,丰富的动作库则能够快速提升制作效率。当前 Cocos 正在内部测试可视化的人体骨骼快速绑定功能,实现导入模型与标准骨骼的快速绑定,从而快速适配 Cocos 动作库中的动作,驱动人物在相关场景中使用。

一直以来,Cocos 引擎始终坚持低门槛、跨平台、轻量化的原则,并在此基础上将不断增加新能力、优化性能与使用体验、迭代底层技术,为各领域开发者带来更易用、稳定的创作工具,让人人成为虚拟角色的使用者与开发者。

无论是对 Cocos 有什么期许,或者是虚拟人商业需求,都欢迎大家点击填写一个简单的调查问卷告诉我们。